Robots.txt Validator in Chrome with OffiDocs

Ad

DESCRIPTION

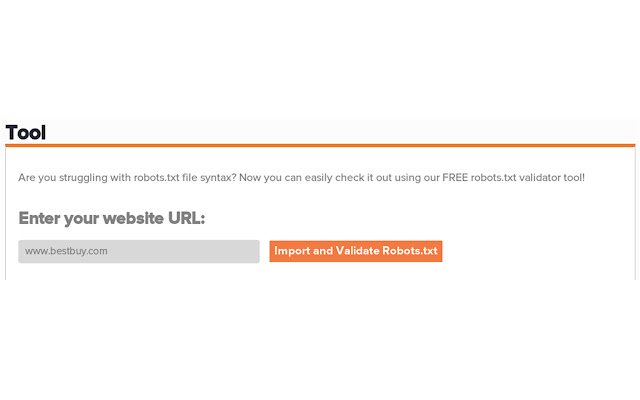

Description Webmasters create a robots.

txt file to instruct search engine robots to crawl and index pages that are a part of a website.

The robots.

txt file can cause major trouble for your website.

If the syntax is wrong you could end up telling search engine robots NOT to crawl your site, so the web pages WON'T appear in the search results.

The importance of analyzing the syntax error of a robots.

txt file cannot be stressed enough! This tool can help you to identify errors that may exist within your current /robots.

txt file.

It also lists the pages that you've specified to be disallowed.

Key Features and Benefits • Validated and error free robots.

txt file can be directly uploaded to your root directory.

• Identifies syntax errors, logic errors, mistyped words and also provides useful optimization tips.

• The validation process takes in account both Robots Exclusion De-facto Standard rules and spider-specific (Google, Yandex, etc.

) extensions (including the new "Sitemap" command).

Additional Information:

- Offered by lxrmarketplace.com

- Average rating : 0 stars (hated it)

- Developer This email address is being protected from spambots. You need JavaScript enabled to view it.

Robots.txt Validator web extension integrated with the OffiDocs Chromium online